Между раем и адом: прогнозы учёных о будущем человечества

|

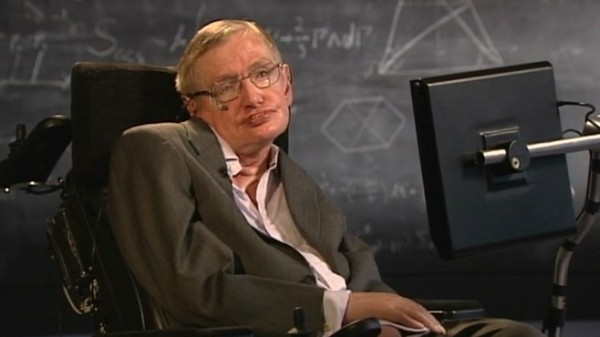

| Стивен Хокинг |

Великий британский физик Стивен Хокинг предупреждает человечество о скорой и почти неминуемой гибели. В новом документальном фильме «Стивен Хокинг: Экспедиция Новой Земли» он перечисляет все основные угрозы, способные уничтожить человечество: перенаселение, астероиды, эпидемии и так далее. Отдельной строкой учёный выделяет опасность атомной войны, искусственного интеллекта и генетически модифицированных вирусов. Он считает, что через сто лет количество угроз перед нашей цивилизацией возрастет настолько, что гибель человечества уже никому не будет казаться фантастикой.

Несколько раньше Хокинг заявлял, что у человечества есть примерно тысяча лет, чтобы избежать гибели, найдя пригодный для жизни мир и колонизуя его. Теперь эти сроки уменьшились в десять раз, так что найти и колонизовать другой мир (считай, Марс) возможным никак не представляется.

|

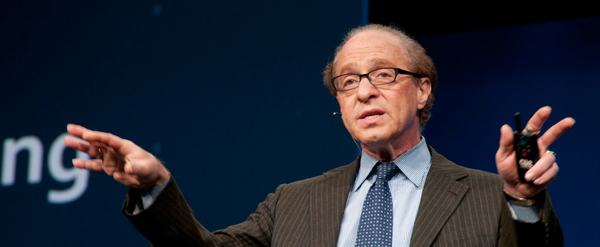

| Рэй Курцвейл |

Хорошая новость пришла от Рэя Курцвейла, американского изобретателя и футуролога, а по совместительству технического директора компании Google. Он собрал воедино все основные прогнозы, данные им в течение двух последних десятилетий, и уточнил сроки их осуществления вплоть до года. Этих прогнозов около 30-ти, и с ними можно познакомиться, например, здесь.

Господин Курцвейл пророчит человечеству рай, причём почти немедленный. Правда, в этой бочке рая кроется почти незаметная глазу ложка ада. Мы не очень понимаем, что имел в виду футуролог «под распространением технологической сингулярности на всю Вселенную» (а как же насчёт скорости света, которую, согласно Эйнштейну, никому превышать не позволено?), но сама эта технологическая сингулярность в переводе на общепонятный язык означает состояние технического прогресса, при котором он станет настолько быстрым и сложным, что окажется недоступен нашему пониманию. И это скорее плохо, чем хорошо.

|

| Владимир Липунов |

Комментируя прогнозы для «ТД», профессор физического факультета МГУ Владимир Липунов благосклонно отнёсся к предсказаниям Курцвейла, но заметил, что даже если все они сбудутся в указанные сроки, нашу цивилизацию это не спасёт. Её гибель, по словам Липунова, неминуемо забрезжит именно через сто, максимум через несколько сотен лет. К этому выводу астрофизик приходит путём несложных вычислений, основанных на том, что почти полвека поисков следов, которые могли бы оставить инопланетные цивилизации, не дали никакого результата.

― Учёные задумывались над этим давно, ― говорит Владимир Липунов. ― Ещё в 1950 году Энрико Ферми задал вопрос о том, что было позже названо Великим молчанием Вселенной: «Если в нашей галактике существует множество внеземных цивилизаций, то почему мы до сих пор не видим такие их следы, как космические корабли или зонды?». В конце 80-х я рассчитал среднее время жизни любой технологической цивилизации в период, когда её технологии начинают развиваться по экспоненте. Если наша планета не уникальна, следует предположить, что разумных, а главное, технологически развитых цивилизаций должно быть много. Они могут входить в контакт друг с другом, если время их существования и расстояние между ними позволяют такой контакт. За миллиарды лет можно если не освоить, то хотя бы изучить всю галактику, оставив повсюду свои следы, и, конечно, войдя в контакт с другими цивилизациями. А если контакта нет, то, значит, жизнь такой цивилизации коротка и, по моим расчётам, составляет в среднем около сотни или нескольких сотен лет. Впоследствии к тем же результатам независимо пришли коллеги из России и США, и это очень хорошо совпадает с прогнозами Стивена Хокинга.

Человек, пишущий эти строки, в силу своего характера с равным скепсисом относится к обоим прогнозам. На его взгляд, обещания Курцвейла в большинстве своем вполне реализуемы, но сроки их исполнения вызывают большое сомнение ― особенно если учесть сопротивление, с которым будут сталкиваться некоторые из этих новаций.

|

| Британский профессор Кевин Уорвик нисколько не сомневается, что в скором времени искусственный мозг перегонит человеческий |

Насчёт скорой гибели человечества тоже можно найти возражения ― хотя бы потому, что встретить её очень не хочется, и приятнее верить в обратное по принципу «авось пронесёт». Однако некоторые ограничения на этот «авось» наложить всё же придётся.

Возьмём, к примеру, искусственный интеллект: один из ведущих специалистов по нему, британский профессор Кевин Уорвик, нисколько не сомневается, что в скором времени искусственный мозг перегонит человеческий. Но тут же оговаривается: главное, по его мнению, не терять контроля над новым разумом, иначе ваш верный помощник превратится в детище Франкенштейна, а его литературный аналог покажется Чебурашкой. Однако, сожалеет профессор, сделать это будет трудно, пока в мире идут войны и воюющие стороны хотят использовать передовое оружие. В такой обстановке, говорит Уорвик, неизбежна быстрая гонка интеллектов, и тут уж будет не до контроля. Если рассматривать прогнозы Курцвейла о людях-киборгах, чипах, внедренных в мозг, нанороботах и так далее, то здесь аналогичная опасность таится в террористах ― они вполне могут использовать эти «чудеса» в своих целях.

Поэтому прежде чем достигать обозначенных футурологом целей, человечеству придётся полностью избавиться и от войн, и от терроризма. Можно попробовать сделать это на Земле, а можно избрать более легкий путь и начать искать подходящую для жизни планету, где нет ни войн, ни террористов. Правда, с определённой точки зрения и это не гарантия: как сказано в одной книге, «когда [люди] будут говорить: "мир и безопасность", тогда внезапно постигнет их пагуба».